TikTok verschärft automatisches Entfernen schädlicher Inhalte

Copyright © Shutterstock/Camilo Concha

TikTok verstärkt seine automatischen Erkennungstools für Richtlinienverstöße. Mit einem neuen Prozess werden Inhalte, die beim Hochladen als Verstoß gegen die Richtlinien erkannt werden, vollständig entfernt, um sicherzustellen, dass niemand diese Videos zu sehen bekommt.

Wie funktioniert das?

Wie TikTok erklärt, durchlaufen derzeit alle TikTok-Videos als Teil des Upload-Prozesses das automatische Scansystem, welches potenzielle Verstöße gegen die Richtlinien identifiziert, die dann von einem Mitglied des Sicherheitsdienstes weiter geprüft werden. Ein Mitarbeiter des Sicherheitsdienstes teilt dem Nutzer dann mit, ob ein Verstoß festgestellt wurde – aber bei der Größe von TikTok bleibt ein gewisser Spielraum für Fehler und eine Gefährdung, bevor eine Überprüfung abgeschlossen ist.

Jetzt arbeitet TikTok daran, dies zu verbessern oder zumindest sicherzustellen, dass mögliches rechtswidriges Material nie einen Zuschauer erreicht.

TikTok erklärt:

“Over the next few weeks, we’ll begin using technology to automatically remove some types of violative content identified upon upload, in addition to removals confirmed by our Safety team. Automation will be reserved for content categories where our technology has the highest degree of accuracy, starting with violations of our policies on minor safety, adult nudity and sexual activities, violent and graphic content, and illegal activities and regulated goods.”

Anstatt potenzielle Verstöße durchgehen zu lassen, blockiert das TikTok-System diese jetzt vor dem Upload, was helfen könnte, die schädlichen Inhalte in der App zu begrenzen.

Natürlich wird es auch einige Fehlalarme geben, was zu einer gewissen Verärgerung bei den Urhebern führt – aber TikTok weist darauf hin, dass sich seine Erkennungssysteme als sehr genau erwiesen haben.

“We’ve found that the false positive rate for automated removals is 5% and requests to appeal a video’s removal have remained consistent. We hope to continue improving our accuracy over time.”

5 % mögen bei Milliarden von Uploads pro Tag eine beträchtliche Zahl sein. Dennoch ist das Risiko der Aufdeckung beträchtlich, und es ist sinnvoll, dass TikTok bei dieser Fehlerquote weiter in die automatische Erkennung geht.

Vorteile und neue Funktionen

Der Aufwand, den die Moderation von Inhalten für die Mitarbeiter mit sich bringt, ist beträchtlich, wie mehrere Untersuchungen gezeigt haben. Jeder Schritt, der unternommen werden kann, um ihn zu reduzieren, ist es wahrscheinlich wert.

“In addition to improving the overall experience on TikTok, we hope this update also supports resiliency within our Safety team by reducing the volume of distressing videos moderators view and enabling them to spend more time in highly contextual and nuanced areas, such as bullying and harassment, misinformation, and hateful behavior.”

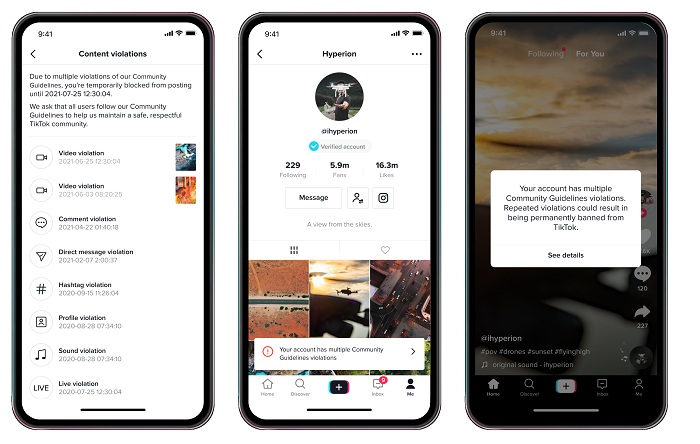

Darüber hinaus führt TikTok auch eine neue Funktion zur Darstellung von Kontoverletzungen und Berichten ein, um die Transparenz zu verbessern – und im Idealfall Nutzer davon abzuhalten, die Grenzen zu überschreiten.

Copyright © Andrew Hutchinson

Wie Sie hier sehen können, zeigt die neue Funktion Verstöße an, die ein Nutzer begangen hat. Außerdem werden neue Warnungen in verschiedenen Bereichen der App angezeigt, um an diese zu erinnern.

Die Strafen für solche Verstöße eskalieren von diesen anfänglichen Verwarnungen bis hin zu vollständigen Sperren, basierend auf wiederholten Vorkommnissen. Bei schwerwiegenderen Verstößen wie Material mit sexuellem Missbrauch von Kindern wird TikTok automatisch Konten entfernen. TikTok kann ein Gerät auch gänzlich sperren, um zu verhindern, dass zukünftige Konten erstellt werden.

Dies sind wichtige Maßnahmen, insbesondere angesichts der jungen Benutzergruppe von TikTok. Interne Daten, die von der New York Times im letzten Jahr veröffentlicht wurden, zeigten, dass etwa ein Drittel der TikTok-Nutzer 14 Jahre alt oder jünger ist. Das bedeutet, dass es innerhalb der App ein erhebliches Risiko für Jugendliche gibt – sowohl als Ersteller als auch Zuschauer.

Mehr Maßnahmen für TikTok

TikTok sah sich bereits mit verschiedenen Untersuchungen an dieser Stelle konfrontiert, einschließlich vorübergehender Verbote in einigen Regionen aufgrund seiner Inhalte. Letztes Jahr geriet TikTok in Italien ins Visier, nachdem ein zehnjähriges Mädchen ums Leben kam, als sie versuchte, einen viralen Trend aus der App nachzustellen.

Fälle wie diese unterstreichen die Notwendigkeit für TikTok, mehr Maßnahmen zu ergreifen, um die Nutzer vor gefährlichen Inhalten zu schützen. Diese neuen Tools sollen helfen, Verstöße zu bekämpfen und zu verhindern, dass sie jemals gesehen werden.

TikTok stellt außerdem fest, dass 60 % der User, die eine erste Verwarnung wegen eines Verstoßes gegen die Richtlinien erhalten haben, keinen zweiten Verstoß begangen haben, was ein weiterer Vertrauensbeweis für den Prozess ist.

Und obwohl es einige Falschmeldungen geben wird, überwiegen die Risiken die potentiellen Unannehmlichkeiten in dieser Hinsicht bei weitem.

Quelle: SocialMediaToday

Keine Kommentare vorhanden