Robots.txt

Copyright © Pexels/Pavel Danilyuk

Was ist die robots.txt?

Bei der Robots.txt handelt es sich um eine einfache Textdatei, in der festgelegt werden kann, welche Bereiche einer Website vom Crawler einer Suchmaschine wie Google gecrawlt werden dürfen und welche nicht. Sie kann mit jedem gängigen Texteditor geöffnet werden und enthält oft auch einen Verweis auf die XML-Sitemap.

Geschichte und Überblick

Das Robots-Exclusion-Standard-Protokoll wurde 1994 entwickelt und wird mittlerweile standardmäßig von allen Suchmaschinen genutzt. Vereinfacht lässt sich sagen, dass in der Robots.txt, die der Betreiber auf seinem Server hinterlegt, festgelegt wird, welche Unterseiten einer Domain von den Suchmaschinen durchsucht werden dürfen. Die Webcrawler der Suchmaschinen suchen beim Erfassen einer Seite stets zuerst nach der Robots.txt. Ist das Protokoll leer, wird automatisch auf die gesamte Website zugegriffen.

Die Datei findet verschiedene Anwendungen. Zum einen ist sie essenziell, wenn die Website einen Mitgliederbereich enthält, der gegebenenfalls sogar kostenpflichtig ist. Ohne die Robots.txt-Datei könnte der Kunde sich die hier hinterlegten Daten per Suchmaschine zusammensuchen, oder Nutzer von außerhalb sensible Mitgliederdaten aufrufen. Der Ausschluss dieses Bereichs durch die Robots.txt verhindert den Zugriff. Das Robots-Protokoll kann jedoch auch solche Sektionen der Website von den Suchmaschinen ausschließen, die persönliche Daten wie Anschrift und Telefonnummer enthalten, wenn diese nur zu Impressumszwecken hinterlegt sind, oder Bildergalerien, wenn diese nicht in der Bildersuche erscheinen sollen.

Im SEO-Bereich hat sich gezeigt, dass es praktisch irrelevant für das Ranking der Website ist, ob und welche Seiten sie durch das Protokoll exkludiert. Die Anwendung des Robots-Protokolles wird von den Suchmaschinen nicht gewertet, sondern lediglich umgesetzt. Wichtig ist jedoch, zu beachten, dass durch das Robots-Protokoll auch Content ausgeschlossen wird, der SEO-optimiert für ein Ranking sorgen soll, nach Anwendung des Protokolls jedoch für die Crawler nicht mehr zur Verfügung steht.

Wie wird die Robots.txt angelegt?

In der Robots.txt müssen zuerst einmal die Bots gelistet sein, die mit dem Protokoll arbeiten sollen. So lässt sich zum Beispiel dem Bingbot eine Unterseite zu crawlen verbieten, während man dem Googlebot den Zugriff auf den gesamten Content gewährt. Die Bots werden in der Txt als “User-Agent:” bezeichnet und untereinander gelistet. Jeder Bot erhält eine eigene Zeile. Danach werden mit “Disallow:” die URL-Endungen gelistet, die vom Crawler nicht berücksichtigt werden sollen. Auch hier ist es wichtig, für jeden Eintrag eine neue Zeile zu wählen.

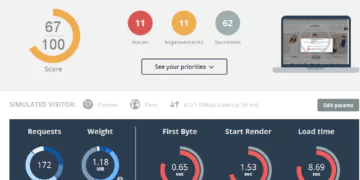

Die Datei ist sehr anfällig für Syntax-Fehler. Bereits der geringste Fehler führt dazu, dass die Crawler das Protokoll missachten und auch Seiten listen, die eigentlich exkludiert sein sollten. Mit den Google Webmaster Tools lässt sich unter “Status” ? “Blockierte URLs” prüfen, ob die Datei korrekt angewendet wird.

Alternativ bieten viele verschiedene Webservices Generatoren für das einfache Anlegen der Robots-Datei ohne Fachkenntnisse. Hier werden die Bots einfach aus Listen ausgewählt und die Unterseiten abgefragt, die geblockt werden sollen. So entsteht ebenfalls eine voll funktionsfähige Protokoll-Datei, die den Zugriff auf die Website regelt.

Sie haben noch Fragen?